Ollama 2026 完全指南:在你的机器上跑 AI 模型的理由和方法

- 1. 本地 AI 不再只是爱好

- 2. 为什么要在本地跑 AI

- 3. 硬件门槛比你想象的低

- 4. 安装与第一条消息

- 5. 模型选择指南

- 6. Modelfile:像 Dockerfile 一样定制 AI

- 7. OpenAI 兼容 API

- 8. Claude Code + Ollama

- 9. UI 选项

- 10. 谁该用 vs 不该用

- 11. 15 分钟开始

1. 本地 AI 不再只是爱好

每当你给 ChatGPT 或 Claude 发送一条消息,你的数据就离开了电脑。Ollama 让一切留在本地——2026 年,这个权衡的天平终于倾向了你这边。

AI 领域正在发生一场安静的叛变。大多数开发者把代码、文档、创意送给 OpenAI、Anthropic 和 Google 的云端 API,但越来越多的人在做不同的事——他们在自己的机器上跑同等级别的模型。

让这成为现实的工具是 Ollama。超过 90,000 GitHub Stars,原生支持 macOS、Windows、Linux,开箱即运行的推理引擎。

2. 为什么要在本地跑 AI

三个驱动力,只有一个是成本:

隐私是最大的原因。 如果你在处理专有代码、客户数据、法律文件、或任何涉及 GDPR/HIPAA 合规的内容,把这些数据发给第三方 API 可能触发合规问题。本地跑,数据不出门。

成本可预测比省钱更重要。 云端 API 按用量收费,重度用户月花 $60-$100+ 的 token 费用。一块 $500 的 GPU 几个月就回本了,之后每次推理都是零边际成本。

延迟和可用性被低估了。 本地模型即时响应,零网络开销。在飞机上、地下室信号不好、离线隔离环境中都能工作。如果你经常在移动中编码或远程工作,这一点比想象中重要。

诚实地面对权衡:本地模型比前沿云端模型(如 Claude Opus 或 GPT-5)更小、能力更弱。一个 7B 模型在你的笔记本上不会匹配 GPT-5 的推理深度,但对于编码辅助、文档分析、代码审查来说,差距已经缩小到几乎没有影响的程度。

3. 硬件门槛比你想象的低

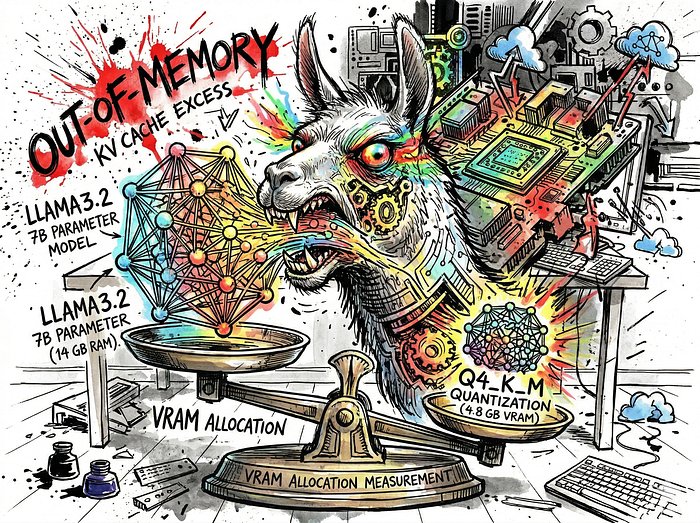

这里大多数人过度思考了。你不需要一万美元的工作站来跑本地 AI。但你需要理解一个关键约束:GPU 显存(或 Mac 的统一内存)决定了你能跑什么模型。

8GB 显存 / 16GB 内存(入门级): 可跑 3B-7B 参数模型。Llama 3.2 3B、Gemma 2 2B。GTX 1070 Ti(8GB)足够。

16-24GB 显存 / 32GB 统一内存(甜点区间): 这是大多数开发者的最佳选择。可跑 Gemma 4 E4B(~9.6GB 磁盘)、Gemma 4 26B MoE(仅激活 4B 参数)、Qwen 3 Coder。一张 RTX 3090 二手卡就能覆盖这个区间。

48+GB 显存 / 64+GB 统一内存(进阶): 30B-70B+ 参数模型。需要双高端 GPU 或 Apple Silicon Mac 64GB+。质量提升明显,但大多数个人开发者不需要这个级别。

让这一切可能的技术是 量化(Quantization)——把模型权重从 16/32 位精度压缩到 4 位甚至 2 位表示。这就像把一张无损音频压缩成 MP3——质量稍微下降,体积大幅缩小。

大多数指南忽略的一个细节:你的显存不仅要装模型权重,还要装 KV Cache——存储整个对话的上下文信息。长对话会额外吃掉 1-3GB。

4. 安装与第一条消息

Ollama 原生支持 macOS、Windows 和 Linux:

macOS: 下载 .dmg 拖到 Applications。直接集成 Metal API 和 MLX 框架,M 系列芯片优化极佳。

Windows: 下载 .exe 安装程序,无需管理员权限。注册为后台服务,暴露 API 在 localhost:11434。

Linux: 一行命令:

curl -fsSL https://ollama.com/install.sh | sh

脚本自动检测架构、下载二进制、配置 systemd 服务、设置 GPU 权限、启动守护进程。绑定到 127.0.0.1:11434,开机自启。

从零到跑起来只要两条命令:

# 下载模型

ollama pull llama3.2

# 运行交互式对话

ollama run llama3.2

支持下特性:粘贴多行代码块、向多模态模型传图片、斜杠命令(/set format json 强制结构化输出)。运行 ollama ps 查看当前加载的模型及其运行位置(GPU/CPU/混合)。

5. 模型选择指南

Ollama 的库托管了超过 100 个模型。如何快速选择:

- 编程助手:Qwen 3 Coder——2026 年 4 月当前本地代码生成和调试的标准,强大的工具调用能力

- 通用对话与推理:Qwen 3——强推理 + 可靠工具调用;Llama 3.2 3B——小模型大能量,极低硬件要求

- RAG 系统:mxbai-embed-large 或 nomic-embed-text——嵌入模型,非聊天模型

- 多模态:LLaVA 模型——直接传图片路径进行分析

诚实的忠告: 不要追你硬件刚好能跑的最大模型。一个在显存和系统内存之间反复交换的模型生成 token 会慢得让人绝望。选一个能完全载入显存的模型,比选一个”看起来参数更大”的模型重要得多。

6. Modelfile:像 Dockerfile 一样定制 AI

Modelfile 是一个声明式配置脚本,让你在任何现有模型上叠加永久系统提示、自定义参数和行为约束:

FROM llama3.2

SYSTEM "你是一个代码审查助手。关注安全性、性能和可维护性。每次提供具体的改进建议。"

PARAMETER temperature 0.3

PARAMETER top_p 0.9

ollama create code-reviewer -f Modelfile

运行后你就有了一个专业代码审查助手,每次调用行为完全一致。Modelfile 可以加入版本控制、团队共享。

Ollama 还支持从 HuggingFace 导入外部模型(.safetensors 格式)和预量化 GGUF 文件,内置量化引擎可在首次加载时压缩超大模型。

7. OpenAI 兼容 API

这是让 Ollama 真正有用的关键特性。Ollama 的 REST API 完全兼容 OpenAI Chat Completions 格式。从 2026 年 1 月起,还支持 Streaming 和 Tool Calling:

from openai import OpenAI

# 把 base_url 从 api.openai.com 改为 localhost

client = OpenAI(

base_url="http://localhost:11434/v1",

api_key="ollama" # Ollama 不验证 key

)

# 代码不用改

response = client.chat.completions.create(

model="qwen2.5",

messages=[{"role": "user", "content": "你好"}]

)

把 api.openai.com/v1 换成 localhost:11434/v1,API Key 随便填——现有应用直接切换,不改代码。

8. Claude Code + Ollama

Anthropic 的 Claude Code 现在可以跑在本地模型上:

ollama launch claude --model glm-4.7-flash

这个命令设置所有环境变量、启动本地模型、启动 Claude Code 指向你的 Ollama 实例。

但需要现实预期:用 7B 本地模型跑 Claude Code 的速度和效果,和用 Claude Opus 在 Anthropic 基础设施上跑是两回事。但对于专有代码绝对不能离开网络的团队,这个设置是革命性的——你获得自主编码辅助,没有任何数据接触外部服务器。

9. UI 选项

- Open WebUI(最佳团队选择):自托管 ChatGPT 风格界面,Docker 部署。多用户认证、RAG 文档摄取、网络搜索、LAN 隧道。

- Jan AI(最佳个人选择):原生桌面应用,看起来像 ChatGPT,连接 Ollama 改个设置就行。无需 Docker,完全离线。

- Msty(最佳进阶用户选择):可视化对话分支、本地 RAG(”Knowledge Stacks”)、远程 GPU 连接。

如果刚开始,Jan 是最快到干净聊天体验的路径。如果为团队搭建,直接上 Open WebUI。

10. 谁该用 vs 不该用

该用 Ollama: 处理敏感数据、需要零边际成本推理、需要离线能力、正在构建集成 AI 的应用不想依赖 API。

留云端: 需要前沿推理质量、不想管硬件、月消费不到 $20、需要顶级多模态能力。

绝大多数开发者处于中间地带——混合模式(本地开发+云端推理)不是妥协,是成熟的选择。

11. 15 分钟开始

- 从 ollama.com 下载安装

- 打开终端运行

ollama pull llama3.2 - 运行

ollama run llama3.2并问点什么

从那里开始:探索更大的模型、构建自定义 Modelfile、连接 Claude Code、部署 Open WebUI。

本地 AI 生态的门槛不是技术或硬件,而是知道这个选项存在。现在你知道了。

相关链接:

- Ollama 官网:ollama.com

- GitHub:github.com/ollama/ollama

- Modelfile 文档:github.com/ollama/ollama/blob/main/docs/modelfile.md

- 2026 开源 LLM 平台横评